Google AI Edge Gallery: cómo ejecutar los modelos Gemma 4 en móviles iOS y Android

por Edgar Otero 1Qué es Google AI Edge Gallery

Hablar de IA en el móvil suele implicar una idea casi automática: que buena parte del trabajo se hace en la nube. Google AI Edge Gallery viene a romper justo con eso. Se trata de una app experimental, de código abierto y desarrollada por Google para ejecutar modelos de IA directamente en el dispositivo, sin depender de servidores remotos para cada consulta. Dicho de otro modo, convierte el teléfono en un pequeño laboratorio de inteligencia artificial que puedes llevar en el bolsillo y usar incluso sin conexión.

La aplicación está disponible tanto para Android como para iOS, y ahora mismo su gran atractivo es la compatibilidad con la familia Gemma 4, los nuevos modelos abiertos de Google pensados para ofrecer un buen equilibrio entre capacidad, eficiencia y ejecución local. Si quieres ponerlos un poco más en contexto, puedes ver también esta noticia sobre Gemma 4, porque ayuda a entender por qué esta propuesta resulta tan llamativa.

Lo interesante de Google AI Edge Gallery es que no se queda en el típico chat con un modelo. La app reúne varios apartados para hablar con la IA, preguntar sobre imágenes, transcribir audio, probar prompts con más control, ejecutar acciones en el dispositivo e incluso trastear con pequeños experimentos. Además, todo esto ocurre en local, lo que aporta una ventaja clarísima: tus mensajes, tus fotos o tus grabaciones no tienen por qué salir del móvil.

Obviamente, estamos ante una beta y eso se nota en el enfoque general. No es tanto una app pensada para un usuario masivo que quiera un asistente pulido, sino más bien una caja de pruebas para experimentar con el presente de la IA on-device. Y precisamente ahí está su gracia. Lo que hace unos meses parecía una demostración para desarrolladores, ahora se puede instalar en un smartphone común y corriente y probar en pocos minutos.

Cómo instalar la herramienta y empezar a usarla

Empezar con Google AI Edge Gallery es bastante sencillo. En Android, la forma más directa es descargarla desde Google Play. Si por cualquier motivo no tienes acceso a esa tienda, también puedes instalar el APK desde la página oficial del proyecto en GitHub. En iPhone, el proceso es todavía más simple, porque está disponible en la App Store. Según la información oficial, los requisitos mínimos son Android 12 o superior e iOS 17 o superior.

Yo la he probado en un iPhone 17 Pro, y la experiencia ha sido francamente buena. La interfaz se mueve con soltura, los modelos responden con agilidad y la sensación general es que hay bastante trabajo detrás pese a tratarse de una beta. Eso sí, una cosa es que la app se instale sin problema y otra muy distinta es cómo va a rendir cada modelo según el hardware de cada móvil. La aplicación, en sí, puede funcionar en muchos dispositivos, pero aquí lo verdaderamente importante es elegir bien el modelo.

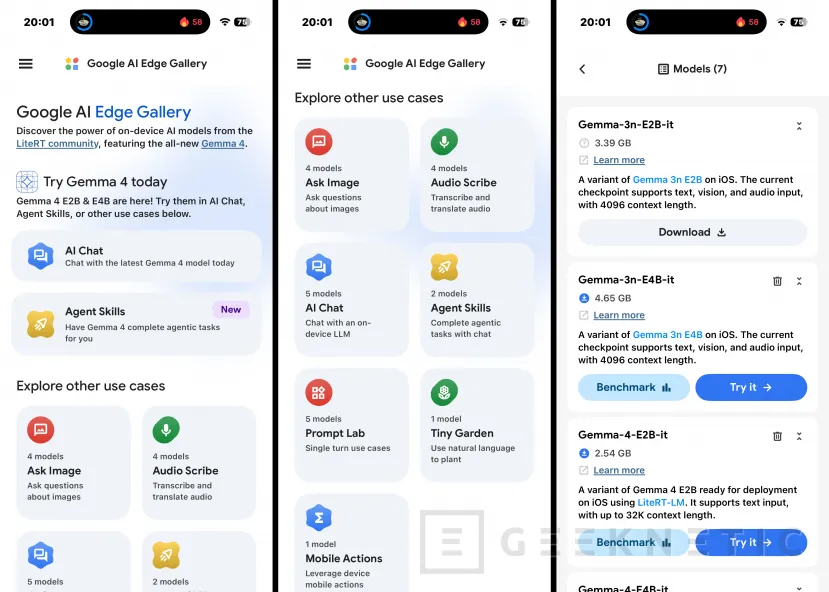

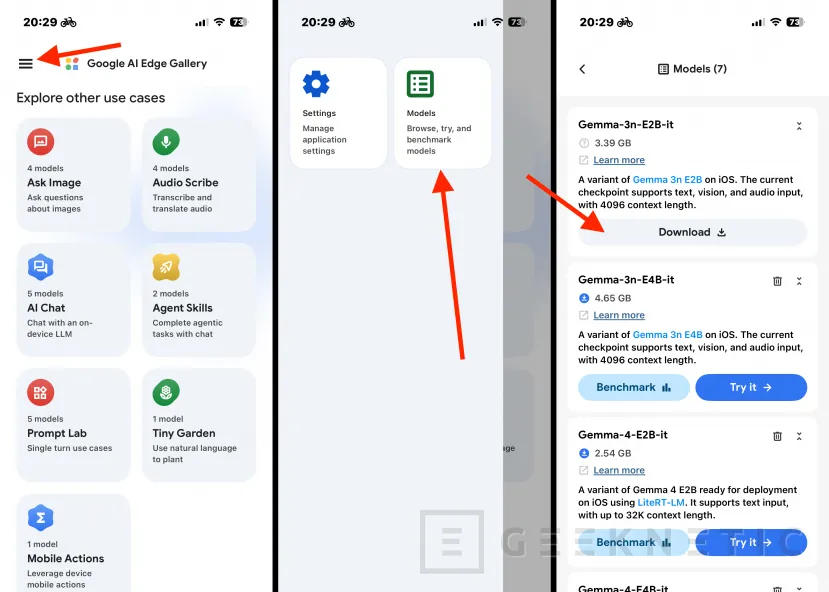

Las capturas dejan ver muy bien cómo está planteada la herramienta. Hay modelos grandes y más ambiciosos, como Gemma-4-E4B-it, que prometen más capacidad, pero también exigen más espacio y recursos. También aparecen alternativas como Gemma-4-E2B-it, Gemma-3n-E2B-it o Gemma-3n-E4B-it, junto a propuestas más pequeñas y especializadas, como Gemma3-1B-IT, MobileActions-270M o TinyGarden-270M. En otras palabras, aquí no siempre gana el más grande. A veces compensa más bajar un modelo algo más ligero si con eso conseguimos una experiencia más rápida y estable.

Pasos para descargar modelos

En este punto, la app también pone las cosas fáciles. No hay que pelearse con menús extraños ni con configuraciones raras.

Lo primero es abrir el menú lateral. Después, toca entrar en el apartado Models, donde aparece la lista de modelos disponibles, su tamaño y las opciones para descargarlos, probarlos o pasarles un benchmark en algunos casos. A partir de ahí, solo hay que pulsar en Download sobre el modelo que más te interese.

Lo bueno es que muchos de ellos son multimodales, así que no están pensados para una sola función. Por ejemplo, Gemma-4-E4B-it, que es el más potente de los que aparecen en las capturas, puede servir como chatbot, para preguntar sobre una imagen o para transcribir audio dentro de la propia aplicación. Es decir, descargas un modelo y luego lo reutilizas en distintos apartados de la app.

Junto a esos modelos más generales, también hay otros mucho más concretos. TinyGarden-270M está pensado para un pequeño experimento jugable en el que usas lenguaje natural para plantar y gestionar un jardín virtual. MobileActions-270M, por su parte, apunta a acciones dentro del dispositivo. Son ejemplos perfectos de que esta app no solo quiere enseñar modelos, sino también enseñar qué tipo de experiencias nuevas se pueden construir con ellos.

Todas las funciones disponibles

Google AI Edge Gallery está organizada como un escaparate de usos reales, y eso hace que sea muy fácil entender para qué sirve cada bloque.

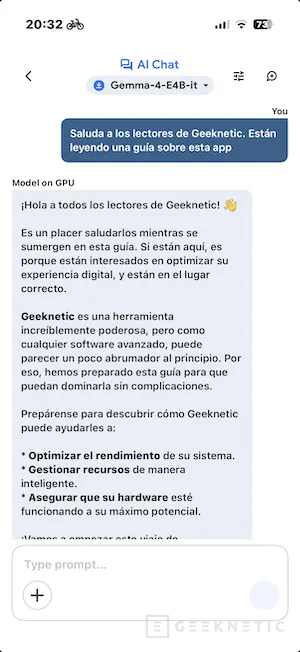

- AI Chat. Es la puerta de entrada más natural. Aquí puedes conversar con el modelo como si fuera un chatbot clásico, pero ejecutándose en el propio teléfono. Es el apartado más directo para medir hasta qué punto la IA local ya puede sentirse rápida y cómoda en el día a día.

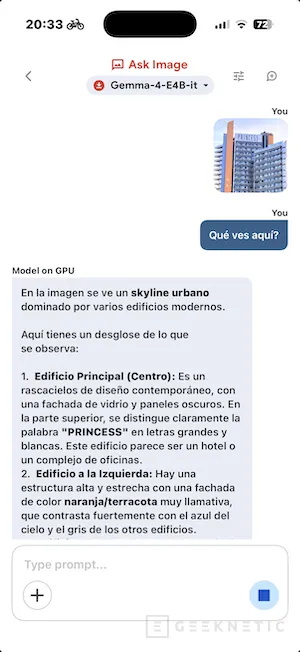

- Ask Image. Este modo aprovecha las capacidades multimodales para analizar fotos e imágenes. Sirve para preguntar qué aparece en una escena, pedir descripciones o incluso usar una imagen como punto de partida para obtener contexto adicional.

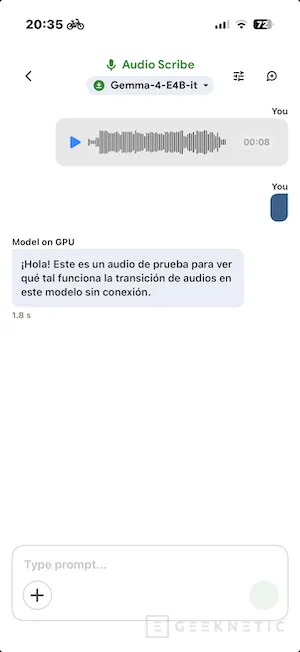

- Audio Scribe. Probablemente, una de las funciones más atractivas de toda la app. Permite transcribir y traducir audio en local, sin depender de servicios externos, lo que la convierte en una herramienta muy llamativa para quien valore privacidad y coste cero.

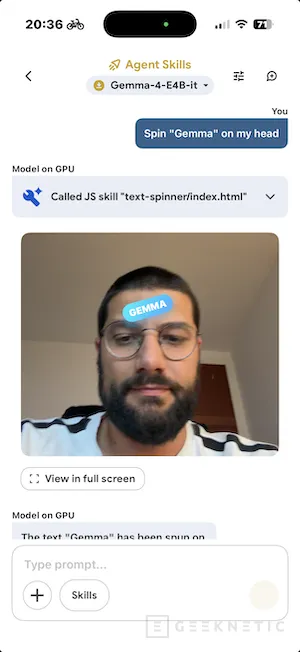

- Agent Skills. Aquí la IA deja de limitarse a responder y gana herramientas adicionales. Es la parte más experimental de la app, porque apunta a un modelo capaz de apoyarse en funciones extra para resolver tareas de una forma más rica.

- Prompt Lab. Es una especie de banco de pruebas para quienes quieren ir un paso más allá. Permite lanzar prompts concretos y jugar con ciertos parámetros para ver cómo cambia el comportamiento del modelo.

- Tiny Garden. Un experimento simpático y bastante útil para entender que la IA local no tiene por qué limitarse a redactar texto. Aquí se usa lenguaje natural para controlar un pequeño juego de jardinería virtual.

- Mobile Actions. Este apartado enseña otra idea interesante: usar modelos afinados para ejecutar acciones dentro del dispositivo. Todavía está en fase muy experimental, pero deja entrever un futuro bastante sugerente.

Como te podrás imaginar, ninguna de estas funciones requiere conexión a Internet, ni una cuenta de Google, ni nada parecido.

Un experimento que merece la pena probar

Google AI Edge Gallery no es todavía la aplicación definitiva que vaya a cambiar por completo cómo usamos la IA en el móvil. Pero sí es una demostración muy seria de hacia dónde se está moviendo todo. Nos acerca a un futuro donde tener una IA capaz funcionando con rapidez y fluidez en nuestro propio dispositivo deje de ser una rareza. Aún hay límites, sobre todo en tamaño, consumo y potencia, pero para mí la dirección es clarísima.

Mientras tanto, ya funciona como una magnífica caja de herramientas para probar cosas muy concretas. Algunas, como la transcripción local, te van a servir ahora mismo, porque permiten hacer tareas útiles, gratis y sin pagar suscripciones ni enviar datos fuera del teléfono. Quizá ese no sea todavía el futuro completo de la IA, pero desde luego sí parece una parte muy importante del futuro que viene.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!