Microsoft vende Copilot como una herramienta seria, pero sus términos siguen diciendo que es “solo para entretenimiento”

por Edgar Otero

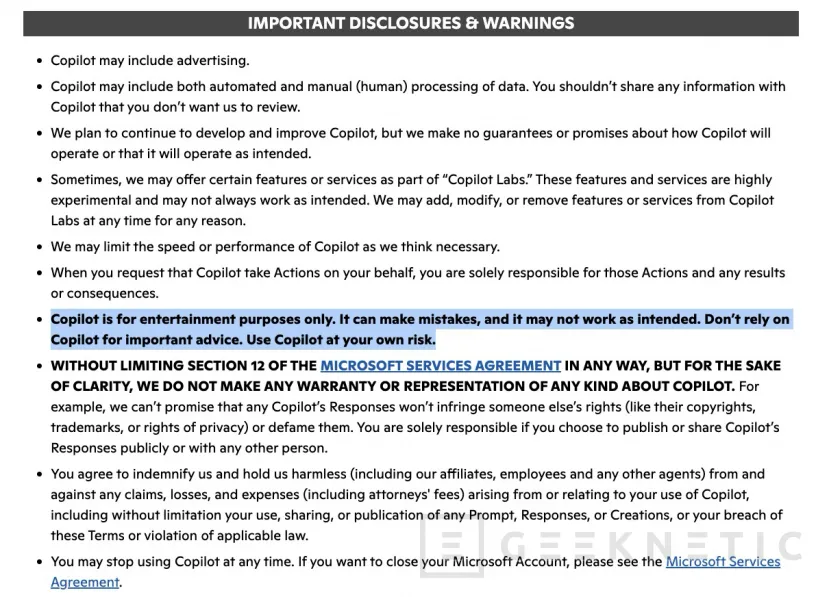

Microsoft se ha encontrado con una contradicción bastante incómoda en plena ofensiva para colocar Copilot en todas partes. Mientras la compañía empuja su inteligencia artificial como asistente de productividad para Windows, Office y entornos empresariales, sus condiciones de uso seguían incluyendo una advertencia difícil de encajar con ese discurso: Copilot era “solo para fines de entretenimiento” y no debía utilizarse para recibir consejos importantes.

La frase, recogida en unos términos de uso actualizados en octubre de 2025, decía literalmente que Copilot podía cometer errores, no funcionar como se esperaba y que el usuario no debía confiar en él para cuestiones relevantes. Tras la polémica, Microsoft aseguró a PCMag que se trata de un “lenguaje heredado” que ya no refleja cómo se usa hoy el producto y que será cambiado en la próxima actualización. La explicación tiene sentido legal, pero no deja de ser llamativa por el momento en que aparece.

Y es que Microsoft lleva meses presentando Copilot justo en la dirección contraria. No estamos hablando de una función experimental escondida en un laboratorio, sino de una IA integrada en herramientas muy cotidianas. Lo vimos cuando Copilot empezó a extenderse dentro de Microsoft Office, con promesas de ayudar a redactar, resumir, analizar documentos y automatizar trabajo de oficina. Ese tipo de integración no encaja precisamente con la idea de un producto para pasar el rato.

El texto era para consumidores, pero la línea entre ocio y trabajo hace tiempo que desapareció

Es verdad que el texto legal al que apuntan las fuentes se refería a la herramienta enfocada a consumidores. Pero incluso ahí la separación entre entretenimiento y uso serio es ya muy difusa. Mucha gente usa Copilot para organizar viajes, redactar correos, planificar tareas o buscar información práctica. Aunque Microsoft no lo venda formalmente como asesor profesional, la propia forma en que ha integrado la IA en su ecosistema empuja a usarla para cosas bastante más relevantes que el puro ocio.

Además, la compañía no ha parado de ampliar el alcance práctico de Copilot. Hace poco vimos cómo Microsoft lanzaba Copilot Tasks, un agente pensado para ejecutar tareas por el usuario. Y antes ya había abierto la puerta a funciones más ambiciosas, como Copilot Vision, capaz de ver lo que aparece en pantalla para asistir al usuario con más contexto. Cuanto más se acerca Copilot a lo operativo, menos creíble resulta mantener un pie legal en el “úselo bajo su propio riesgo para entretenimiento”.

Una ironía bastante común en la industria de la IA

La parte irónica es que Microsoft no es una excepción aislada. Otras compañías del sector también incluyen advertencias parecidas en sus condiciones. El patrón se repite. Por un lado, las empresas presentan sus modelos como multiplicadores de productividad, asistentes de trabajo y herramientas cada vez más centrales. Por otro, el texto legal rebaja expectativas para cubrirse ante errores, alucinaciones o mal uso. La ambición comercial va por una vía y la prudencia jurídica por otra.

Eso no significa que Microsoft esté mintiendo al corregir ese texto. Es perfectamente posible que el lenguaje se hubiera quedado viejo frente al producto actual. Pero precisamente ahí está el problema. Si una compañía lleva meses vendiendo Copilot como una herramienta seria y transversal, no debería descubrirse a estas alturas que sus propias condiciones todavía lo tratan como entretenimiento. Porque entonces, cuando toca convencer al cliente, la IA sirve para trabajar. Ahora bien, cuando toca protegerse legalmente, vuelve a ser poco más que un juguete probabilístico.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!