Anthropic llevará al Pentágono a los tribunales por designarla riesgo para la cadena de suministro

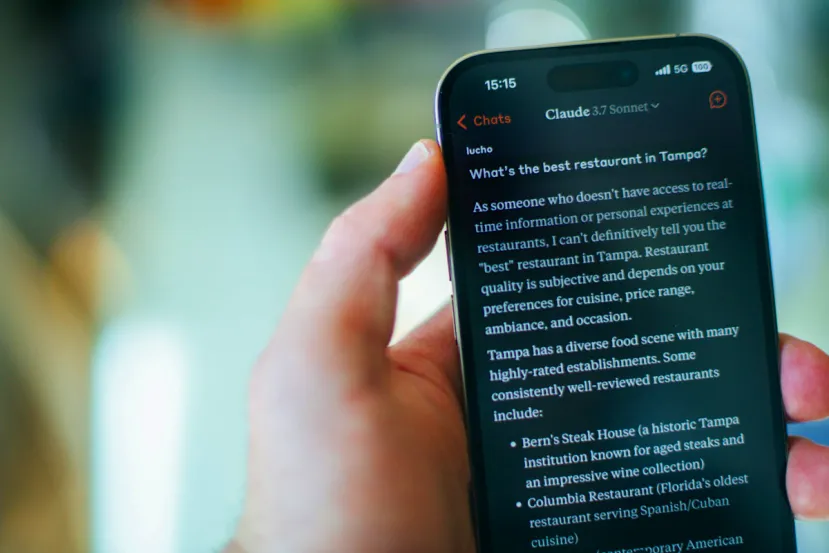

por Edgar OteroEl conflicto entre Anthropic y el Departamento de Defensa de Estados Unidos ha dado un nuevo giro. Pocas horas después de que el Pentágono hiciera oficial la designación de la compañía como riesgo para la cadena de suministro, su CEO, Dario Amodei, anunció que la empresa planea impugnar esa decisión en los tribunales, calificándola de "legalmente infundada".

La designación, impulsada por el secretario de Defensa Pete Hegseth, es una clasificación habitualmente reservada para amenazas a la seguridad nacional. En la práctica, puede impedir que una empresa trabaje con el Pentágono y sus contratistas. El origen del conflicto, como se pudo conocer semanas atrás, está en la negativa de Anthropic a eliminar dos restricciones de uso de su IA: la vigilancia masiva de ciudadanos estadounidenses y el desarrollo de armas totalmente autónomas. El Pentágono exigía acceso sin restricciones para "todos los usos legales".

Mientras tanto, OpenAI firmó rápidamente un acuerdo para cubrir ese hueco, lo que no ha estado exento de críticas internas dentro de la propia compañía. Este posicionamiento también ha tenido consecuencias en el uso de sus productos por parte de los consumidores. El contraste entre ambas posturas ha reforzado la percepción pública de que Anthropic es la empresa que puso límites éticos por encima del negocio, aunque la compañía no ha buscado activamente ese relato.

Por qué Anthropic cree que tiene argumentos legales sólidos

En su declaración, Amodei ofreció un avance de lo que probablemente será el eje de su estrategia judicial. Su argumento central es que la designación tiene un alcance mucho más estrecho de lo que el Pentágono sugiere, y que la propia ley que la respalda obliga al Secretario de Defensa a usar los medios menos restrictivos posibles para proteger la cadena de suministro.

"La designación existe para proteger al gobierno, no para castigar a un proveedor", escribió Amodei. Según su interpretación, la medida solo afecta al uso de Claude como parte directa de contratos con el Departamento de Defensa, no a todos los clientes que puedan tener algún tipo de relación con el Pentágono. Dicho de otro modo, una empresa tecnológica que use Claude internamente y que también tenga contratos militares no estaría obligada a abandonar el producto, siempre que ese uso no esté vinculado directamente a esos contratos.

Amodei fue explícito al respecto: "La designación no limita, ni puede limitar, los usos de Claude o las relaciones comerciales con Anthropic que no estén relacionados con contratos específicos del Departamento de Defensa". La compañía insiste en que la gran mayoría de sus clientes no se ven afectados.

Con todo, los expertos advierten de que el camino judicial no será sencillo. La ley que ampara este tipo de designaciones da al Pentágono un amplio margen de discrecionalidad en materia de seguridad nacional, y los tribunales suelen mostrarse reluctantes a cuestionar esas decisiones. Dean Ball, exasesor de la Casa Blanca en asuntos de IA durante la era Trump y uno de los críticos más abiertos del trato recibido por Anthropic, lo resume así: el listón es muy alto, pero no imposible de superar.

El memo filtrado y un conflicto que no para de escalar

La semana ha estado marcada también por un episodio incómodo para la compañía. Un memo interno que Amodei envió a sus empleados fue filtrado a los medios. En él, describía los acuerdos de OpenAI con el Pentágono como "teatro de seguridad", una frase que generó ruido en un momento especialmente delicado de las negociaciones. Algunos apuntan a que esa filtración pudo haber perjudicado las conversaciones que, según el propio Amodei, estaban siendo productivas hasta ese momento.

En su declaración del jueves, Amodei pidió disculpas por el tono del documento, aclarando que fue escrito en pocas horas, en lo que describió como "un día difícil para la compañía", y que no refleja sus valoraciones más meditadas. También negó que la compañía hubiera filtrado el memo intencionadamente.

El contexto en el que se mueve todo esto sigue siendo extraordinariamente tenso. Como se informó la semana pasada, el Departamento de Defensa utilizó herramientas de Anthropic para planificar el ataque contra Irán del 28 de febrero, pocas horas después de que Trump ordenara el cese del uso de su tecnología en sistemas federales. Anthropic, por su parte, ha confirmado que seguirá proporcionando sus modelos al Pentágono a coste mínimo durante el tiempo que sea necesario para completar la transición, priorizando el acceso de los militares y analistas de seguridad nacional a las herramientas que necesitan en medio de operaciones activas.

La demanda se presentaría previsiblemente en un tribunal federal de Washington. Sin fecha concreta aún, el litigio promete convertirse en uno de los casos más relevantes sobre los límites del uso militar de la inteligencia artificial. Seguiremos muy atentos.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!