Los modelos LLM locales llegan al iPhone

En esta guía te voy a mostrar una herramienta que te permite descargar e instalar modelos de lenguaje en tu iPhone. Se trata de una aplicación totalmente gratuita que funciona de manera parecida a Ollama, una aplicación basada en línea de comandos con la que puedes instalar DeepSeek-R1 en tu PC. ¿Y cuál es el objetivo de esta guía?

Mi intención es enseñarte a interactuar con modelos de lenguaje que, debido a su tamaño, son totalmente funcionales en un iPhone más o menos moderno. De esta manera, mantienes tu privacidad y eliminas el requisito de la conexión a Internet que la mayoría de los chatbots tienen. Tampoco es necesario que te abras una cuenta online ni que facilites tus datos a nadie. Lo que hagas con los modelos no sale de tu iPhone. ¿Ponemos manos a la obra?

Requisitos para ejecutar un LLM en el iPhone

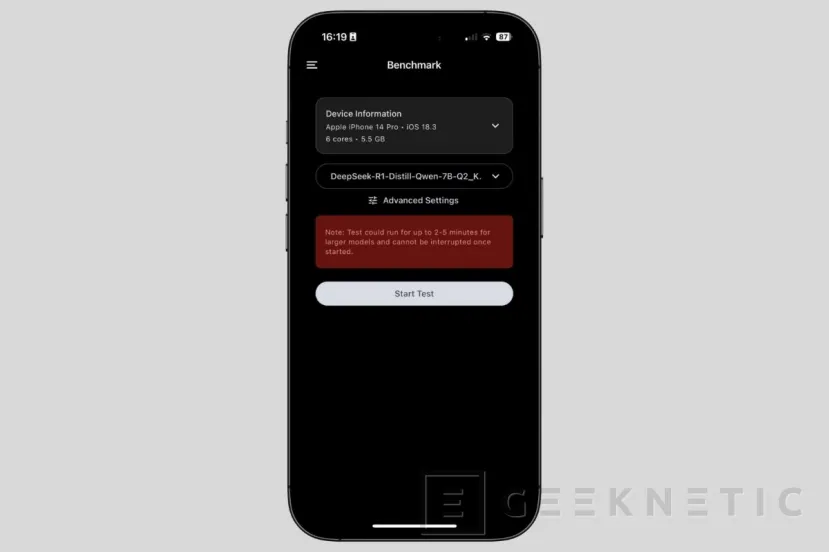

Para ejecutar modelos locales en el iPhone no hay que cumplir ningún requisito especial. Por mi parte, he probado este método en un iPhone 14 Pro. En el momento en el que escribo estas líneas, se trata de un modelo que está dos generaciones por detrás del modelo más actual. Dejando a un lado que este es mi dispositivo personal y que no tengo acceso a ningún iPhone más actual, lo cierto es que utilizar este dispositivo me parece una buena idea.

Hay que recordar que Apple Intelligence, el paquete de herramientas de IA, está disponible a partir del iPhone 15 Pro. Después de revisar muchas pruebas de otros analistas, parece que Apple está combinando la nube y los modelos locales de menor tamaño. No es necesario probar un LLM local para confirmar el secreto a voces de Apple: restringir estas funciones a los modelos más actuales no es más que una estrategia de mercadotecnia.

Mi recomendación, sin importar el iPhone que tengas, es que sigas los pasos que te muestro a continuación. Entonces, prueba con diferentes modelos para ver cuánto da de sí tu dispositivo. Puedes probar con total tranquilidad modelos grandes sin miedo a dañar tu iPhone. En el caso de que el modelo sea demasiado pesado, la aplicación colapsará. Bastará con volver a acceder a ella para probar con otro modelo distinto.

DeepSeek-R1 7B y otros modelos en local en tu iPhone gracias a PocketPal

Ya han aparecido en la App Store algunas aplicaciones que te permiten bajar y utilizar de forma local diversos modelos de lenguaje. La que mejor me ha funcionado es PocketPal. Hay algunas cosas que me han gustado mucho de esta aplicación, aunque luego te las explico.

Por ahora, veamos cómo configurarla. Lo primero que debes hacer es descargar PocketPal desde la App Store. Una vez la tengas en tu dispositivo, sigue estos pasos:

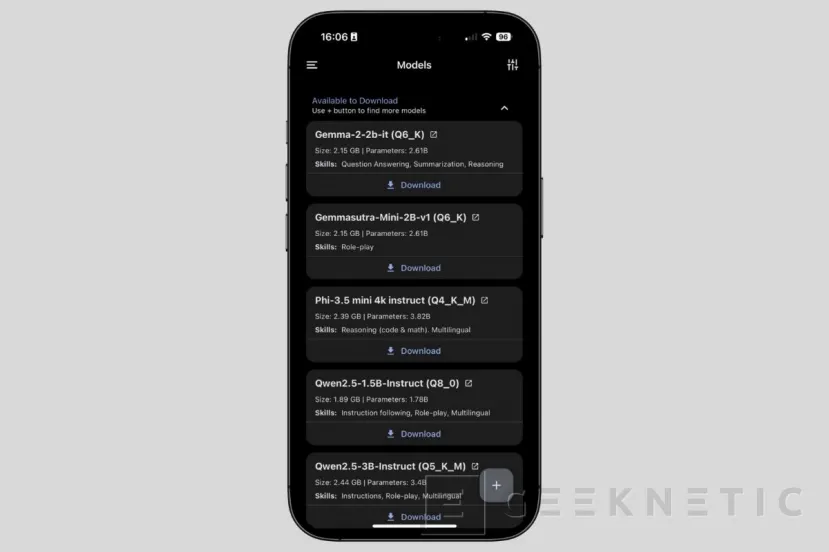

- Presiona el botón Go To Models para ver el listado de modelos disponibles.

- Toca en Download para bajar alguno de los que ves en la lista.

- Si prefieres explorar modelos de Hugging Face, pulsa en el botón Más. Luego, selecciona la opción correspondiente.

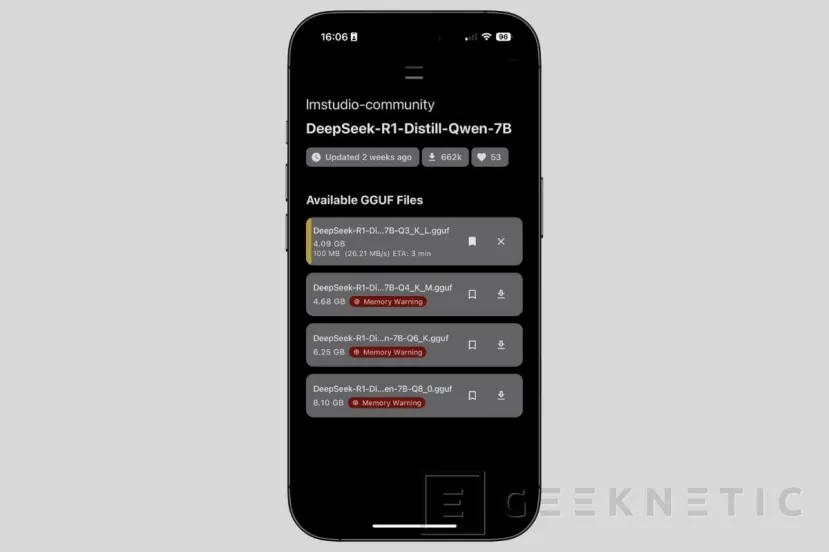

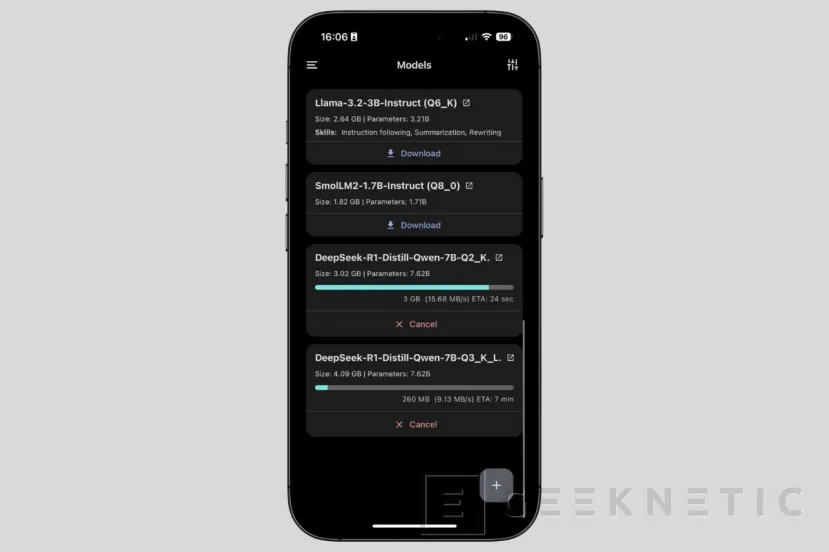

- Usa el buscador para encontrar el modelo que deseas utilizar. Yo he encontrado uno de DeepSeek-R1 destilado con Qwen. Tiene un tamaño de 7 billones de parámetros. El progreso de la descarga aparece en amarillo.

- Si regresas al listado principal, verás que los modelos se están descargando.

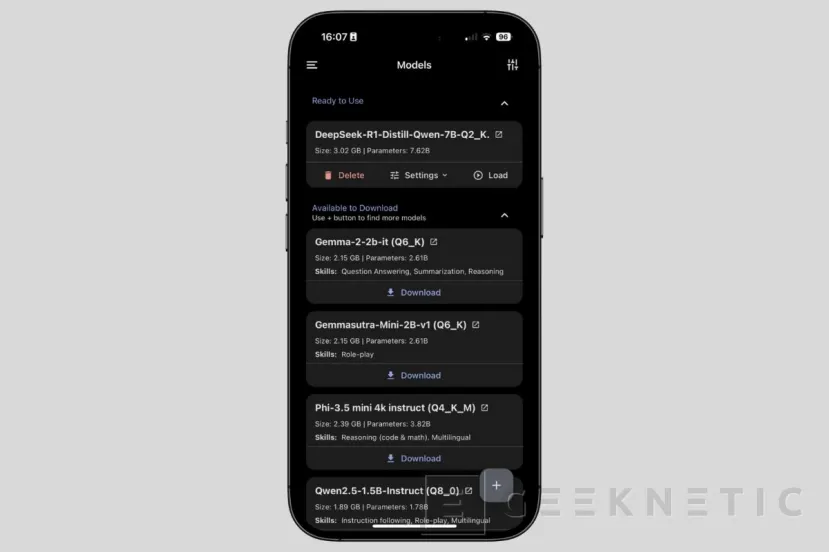

- Una vez aparezcan los modelos en el apartado Ready to use, el último paso es presionar en Load.

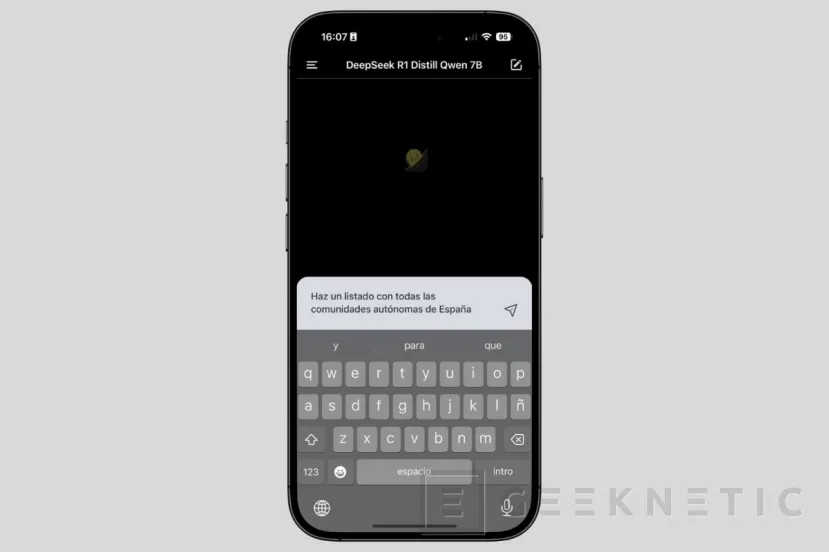

- Abre un chat nuevo y escribe tu petición.

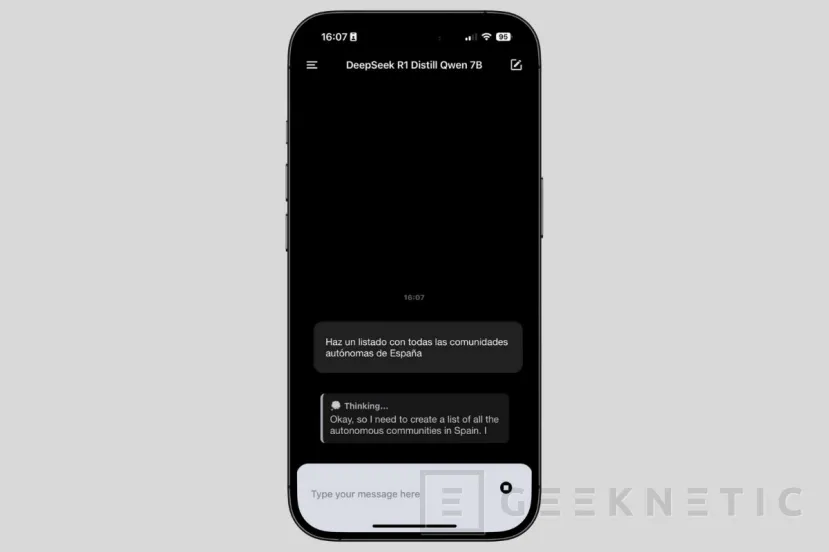

- Finalmente, deja que el modelo responda.

El rendimiento dependerá del procesador de tu iPhone. Cuanto más nuevo sea, más rápido irán los modelos. Mi recomendación es que, en los dispositivos más recientes, ejecutes modelos de 7 u 8 billones de parámetros. Quizá puedas ejecutar alguno un poco más grande, siempre y cuando tengas paciencia. Los modelos más pequeños te pueden ayudar a resolver dudas rápidas, resumir texto y procesar datos básicos.

El punto fuerte de esta aplicación, además de no requerir conexión y que inicies sesión con una cuenta, es que viene con algunas herramientas adicionales. Por ejemplo, permite hacer un benchmark al dispositivo usando cualquier modelo que hayas descargado.

Además, cuenta con opciones típicas de ChatGPT. Por ejemplo, permite editar las peticiones después de haber sido enviadas. También es compatible con Metal, la API gráfica de Apple, lo cual permite aprovechar al máximo la GPU del iPhone (hay que activarlo en los ajustes). Ahora bien, su integración con Hugging Face es, sin duda, su mejor baza. Esto último abre las puertas, no solo a utilizar modelos de lenguaje en local y desde el iPhone, sino a ejecutar modelos de difusión para crear imágenes directamente desde tu dispositivo.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!