Las GTX 970 tienen un bus efectivo de 224 bits y solo pueden usar eficientemente 3,5GB

por Antonio Delgado 17

Esta mañana os hablábamos de un problema que sufrían todas las GTX 970 de NVIDIA relacionado con su memoria, que hacía que cuando la tarjeta necesitaba más de 3,5 GB de vRAM se producía una penalización más que notable en su rendimiento.

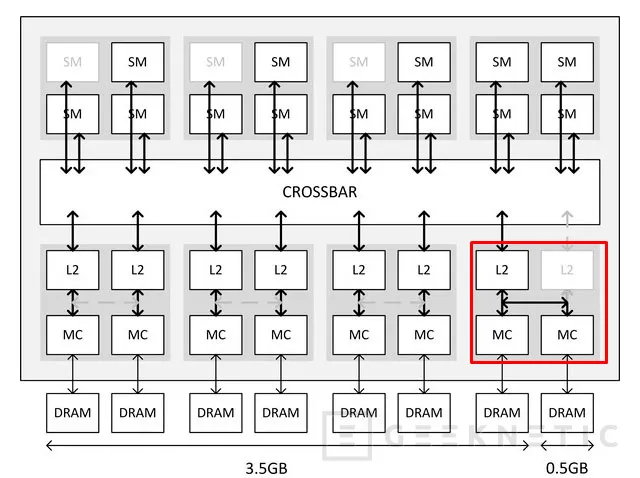

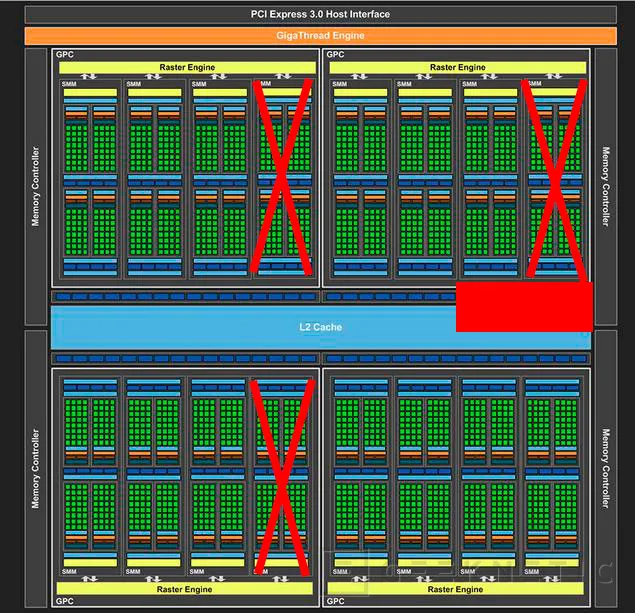

La explicación inicial de NVIDIA fue que el chip GM204 utilizado en estas gráficas tenía 3 SMM menos que la GTX 980 (GM204 completo), y que por ello necesitaban particionar la memoria en dos partes de 3,5 GB y 512 MB para acceder de manera eficiente a los primeros 3,5 GB. En su momento nuestras cábalas apuntaban a la eliminación de los bloques de caché L1 pertenecientes a los 3 SMM eliminados, lo que nos dejaba con 7 bloques. Sin embargo estábamos equivocados y el problema es mucho más sencillo y grave a la par.

Según comentan en Hardware.fr, las especificaciones que NVIDIA ha publicado sobre su GTX 970 son falsas ya que, a pesar de haber anunciado que esta GPU contaba con 64 ROPs, en realidad tiene 8 de ellas desactivadas, lo que nos deja con tan solo 56 ROPs o Render OutPut Unit.

Al esta asociadas las ROPs a la caché L2, el eliminar 8 de estas unidades de rasterizado, cada una con 32 KB de caché L2 asociada, perdemos también 256 KB de memoria caché L2 de los 2.048 KB que, según NVIDIA, tenía la GTX 970, por lo que la cantidad real de caché L2 de las GTX 970 es de 1.792 KB.

Si bien en arquitectura Maxwell, la caché L2 y las ROP no están vinculadas con el controlador general de memoria ni la interfaz de memoria, la GTX 970 sigue manteniendo un bus de datos físico de 256 bits para acceder a los 4 GB de memoria GDDR5 que integra, pero no puede hacer uso de la totalidad de ese bus. Aunque el bus de memoria real es de 256 bits, la tarjeta gráfica no estará utilizando esos 256 bits, sino 224 bits. Tenemos 4 bits por cada ROP, y tenemos 56 ROPS, lo que nos da 224 bits. Imaginémonos que el bus de memoria es una autopista con 256 carriles, en este caso tan solo circularían vehículos por 224 de los carriles disponibles, porque no hay nadie que envíe coches por el resto de carriles

De esta manera, 3,5 GB de memoria de la GTX 970 están conectados directamente a la caché L2 y a sus correspondientes ROP, por lo que el rendimiento no se verá afectado al utilizar esa cantidad de memoria. El problema llega cuando necesitamos acceder a los últimos 512 MB de los 4 GB de vRAM de la tarjeta. Esos 512 MB no pueden direccionarse directamente desde la caché L2, por lo que la tarjeta tiene que aprovechar una sección de la caché L2 existente para poder acceder a ese espacio de memoria.

De esta manera, el rendimiento se ve penalizado al tener que enviar más datos de los que puede manejar esa caché L2 de forma óptima, y ahí es cuando ocurren los micro cortes. Parece que Nvidia da prioridad a los tipos de datos que más influyen en el rendimiento, de tal forma que la penalización no sea tan grande, pero a fin de cuentas es inevitable no sufrir una pérdida de rendimiento cuando exigimos el uso de más de 3,5 GB de vRAM.

Podríamos preguntarnos por qué NVIDIA se ha decantado por introducir 4 GB de memoria en una tarjeta con estas limitaciones en vez de integrar tan solo 3,5 GB y evitar los problemas derivados al acceder a los 512 MB restantes.

Realmente, en el caso de ejecutar un juego que requiera más de 3,5 GB, vamos a obtener más rendimiento utilizando esos 512 MB que penalizan al desempeño de la tarjeta, que haciendo uso de la memoria principal del sistema, con un ancho de banda muy inferior que se vería reducido todavía más por las limitaciones de ancho de banda del puerto PCI Express.

Sin embargo si bien las GTX 970 no van a rendir menos de lo que llevan rindiendo desde su salida, sí que hay una diferencia entre las especificaciones que realmente se anuncian y el producto que se adquiere, por lo que habrá que ver la reacción de los usuarios y la respuesta de NVIDIA.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!