nVidia Geforce 8800GTX. Primera Parte

por Javier Rodríguez ...Introducción

Introducción El mes de Noviembre ha sido prolífico en diferentes novedades en lo referente a informática y electrónica de consumo pero sin duda uno de los productos mas esperados era el primer motor DirectX 10 para ordenadores sobremesa. nVidia ha pegado tan fuerte con este nuevo producto que no recuerdo algo similar desde los tiempos de la primera geforce. Un cuidado lanzamiento en todo el mundo con pocos días de diferencia y la disponibilidad de tarjetas desde el primer día han propiciado este efecto sobre toda la comunidad gamer. Nosotros ya disponemos de nuestra 8800GTX a la que someteremos durante los dos próximos artículos al primer grado probando cada uno de sus aspectos y analizando el producto al milímetro. Todas las 8800GTX comparten arquitectura y prestaciones, las diferencias si las hubiera no serian mas que circunstanciales, pero la que nosotros tendremos la oportunidad de analizar es un modelo estándar de XFX. Principal partner gráfico de nVidia en los últimos años y para algunos un referente en calidad. XFX Geforce 8800GTX

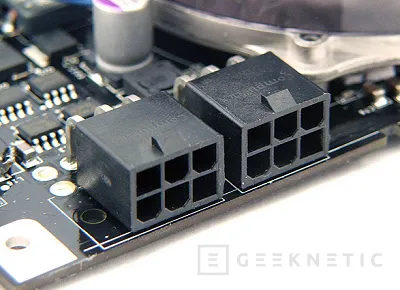

Monta como ya sabéis una configuración "extraña" de framebuffer con 768MB y un bus de memoria de 384-Bit. La memoria utilizada es GDDR3 con una frecuencia de trabajo de 900MHz reales y 1800MHz DDR teóricos. Esto arroja unas cifras cercanas a los 90GB/s lo que es hasta la fecha el ancho de banda mas elevado que se haya visto en una tarjeta gráfica. El núcleo de la 8800GTX no trabaja, debido seguramente a que conserva un proceso de fabricación de 90nm, a frecuencias muy elevadas, que es lo que se espera en un cambio de generación, viene de serie a 575Mhz y tampoco es una tarjeta grafica "fresca" por lo que si queremos aumentar su velocidad deberemos hallar un sistema de refrigeración por agua que encima nos controle el calor generado por otros componentes de la tarjeta como su alimentación o las propias memorias. Sin entrar por ahora en los detalles de su arquitectura la 8800GTX no es precisamente un alarde de ingeniería en cuanto al cuidado de la tarjeta. Requiere una disipación de tamaño descomunal, aunque esta es la tendencia marcada tanto por nvidia como AMD-ATI, se calienta y consume mas energía que dos procesadores de cuatro núcleos puestos juntos y encima monta un PCB de tal tamaño que me recuerda a mi primera Sounblaster AWE32 que era como una barra de pan. Para colmo encima tenemos que meterle dos conectores auxiliares de corriente del tipo PCI Express así que necesitaremos una fuente SLI, con una potencia conjunta de 12v de unos 30A y una caja donde los discos no estorben mucho porque esta tarjeta es mas larga incluso que una placa base ATX de dimensiones grandes. La 8800GTX será una gran tarjeta en cuanto a rendimiento y prestaciones pero en otros muchos aspectos, en mi opinión, es un desastre de diseño y esperemos que en generación futuras nVidia haga algo para solucionarlo y sino que aprendan de la evolución de las marcas de procesadores que se han dado cuenta, algunos tarde, de que es tan importante el rendimiento como el resto de factores tan importantes algunos como el ruido y el consumo.

Monta como ya sabéis una configuración "extraña" de framebuffer con 768MB y un bus de memoria de 384-Bit. La memoria utilizada es GDDR3 con una frecuencia de trabajo de 900MHz reales y 1800MHz DDR teóricos. Esto arroja unas cifras cercanas a los 90GB/s lo que es hasta la fecha el ancho de banda mas elevado que se haya visto en una tarjeta gráfica. El núcleo de la 8800GTX no trabaja, debido seguramente a que conserva un proceso de fabricación de 90nm, a frecuencias muy elevadas, que es lo que se espera en un cambio de generación, viene de serie a 575Mhz y tampoco es una tarjeta grafica "fresca" por lo que si queremos aumentar su velocidad deberemos hallar un sistema de refrigeración por agua que encima nos controle el calor generado por otros componentes de la tarjeta como su alimentación o las propias memorias. Sin entrar por ahora en los detalles de su arquitectura la 8800GTX no es precisamente un alarde de ingeniería en cuanto al cuidado de la tarjeta. Requiere una disipación de tamaño descomunal, aunque esta es la tendencia marcada tanto por nvidia como AMD-ATI, se calienta y consume mas energía que dos procesadores de cuatro núcleos puestos juntos y encima monta un PCB de tal tamaño que me recuerda a mi primera Sounblaster AWE32 que era como una barra de pan. Para colmo encima tenemos que meterle dos conectores auxiliares de corriente del tipo PCI Express así que necesitaremos una fuente SLI, con una potencia conjunta de 12v de unos 30A y una caja donde los discos no estorben mucho porque esta tarjeta es mas larga incluso que una placa base ATX de dimensiones grandes. La 8800GTX será una gran tarjeta en cuanto a rendimiento y prestaciones pero en otros muchos aspectos, en mi opinión, es un desastre de diseño y esperemos que en generación futuras nVidia haga algo para solucionarlo y sino que aprendan de la evolución de las marcas de procesadores que se han dado cuenta, algunos tarde, de que es tan importante el rendimiento como el resto de factores tan importantes algunos como el ruido y el consumo.

La 8800GTX de XFX al detalle

La 8800GTX de XFX al detalle. Hemos desarmado totalmente la 8800GTX, lo cual es toda una odisea porque el disipador tiene al menos 20 tornillos de diversos tamaños, no solo para intentar mejorar la conducción de calor de la GPU cambiando la pasta térmica sino para que podáis ver en imágenes lo que realmente es una 8800GTX que es algo más que una tarjeta pegada a un disipador enorme con Heatpipes.

Prestaciones 2D

Prestaciones 2D.  Todas las 8800GTX incorporan un doble conector DVI del tipo I que permite adaptación a monitores analógicos con conector "VGA". Añade dos DACs de 400Mhz para este control analógico y una salida de TV de alta definición con formatos de hasta 1080i mediante conexión por componentes. La 8800GTX, como muchas otros modelos de la serie 7 de nvidia, soporta la tecnología PureVideo HD. Este sistema esta preparado tanto para los controles de propiedad HDCP como para los estándares de video que usan ya los lectores HD-DVD y Blu-Ray como son el H-264, VC.1, MPEG2 o WMV9. Esto facilita a sus usuarios el poder disfrutar de descodificación por hardware y software

Todas las 8800GTX incorporan un doble conector DVI del tipo I que permite adaptación a monitores analógicos con conector "VGA". Añade dos DACs de 400Mhz para este control analógico y una salida de TV de alta definición con formatos de hasta 1080i mediante conexión por componentes. La 8800GTX, como muchas otros modelos de la serie 7 de nvidia, soporta la tecnología PureVideo HD. Este sistema esta preparado tanto para los controles de propiedad HDCP como para los estándares de video que usan ya los lectores HD-DVD y Blu-Ray como son el H-264, VC.1, MPEG2 o WMV9. Esto facilita a sus usuarios el poder disfrutar de descodificación por hardware y software  de estos formatos de alta definición con resoluciones Full HD. También los dos DVI de esta tarjeta soportan este tipo de formatos incluido también el Dual-Link que permite soportar resoluciones de hasta 2560x1600 puntos que es la que usan los monitores de 30" que son el formato mas grande que encontraremos en pantallas para ordenador. De hecho el formato VGA no da para más así que habrá que esperar a otro estándar para ver mayores resoluciones que esta en un PC. El sistema PureVideo HD dispone de soporte por hardware pero también requeriremos de software reproductor adaptado a esta tecnología, la suerte es, que software hay de sobra ya que tanto PowerDVD como WinDVD y Nero soportan dicha tecnología. Además la profundidad de color es de 10-Bit por canal lo que en principio iguala la calidad de imagen a la de los mejores productos hasta ahora conocidos. Aunque esto tampoco es nuevo de esta generación.

de estos formatos de alta definición con resoluciones Full HD. También los dos DVI de esta tarjeta soportan este tipo de formatos incluido también el Dual-Link que permite soportar resoluciones de hasta 2560x1600 puntos que es la que usan los monitores de 30" que son el formato mas grande que encontraremos en pantallas para ordenador. De hecho el formato VGA no da para más así que habrá que esperar a otro estándar para ver mayores resoluciones que esta en un PC. El sistema PureVideo HD dispone de soporte por hardware pero también requeriremos de software reproductor adaptado a esta tecnología, la suerte es, que software hay de sobra ya que tanto PowerDVD como WinDVD y Nero soportan dicha tecnología. Además la profundidad de color es de 10-Bit por canal lo que en principio iguala la calidad de imagen a la de los mejores productos hasta ahora conocidos. Aunque esto tampoco es nuevo de esta generación.

Arquitectura 3D. DirectX 10

Arquitectura 3D. DirectX 10. nVidia puede presumir a todos los efectos de tener en el mercado una tarjeta compatible totalmente con DirectX 10 meses antes de que el sistema operativo que lo soporta salga a la venta a nivel usuario. La pena es que han sido rápidos para dar soporte al software de Microsoft pero ellos no dar soporte de software a su propia tarjeta ya que a día de hoy los drivers son realmente malos, y tan siquiera tienen soporte DirectX 10 ya que la versión de drivers actuales, además de no ser para la versión final de Windows Vista sino de la RC2, tampoco tiene soporte para la 8800 asi que tenemos una pedazo de tarjeta DirectX 10 pero sin DirectX 10. Salvando este problemilla que estará solucionado este mismo Viernes, según fuentes de la propia nVidia, así que dejémoslo en un pequeño tirón de orejas y también recordemos el buen historial de drivers y de actualizaciones que honran la trayectoria de nVidia y no solo para los sistemas operativos mas extendidos sino para todas las tendencias de software libre y comercial. Es impresionante que dará, después de navidades, Fligh Simulator X, con el parche que se espera para DirectX 10. Aquí teneis el antes (SM 3.0) y el después (SM 4.0).

Arquitectura unificada para DirectX 10

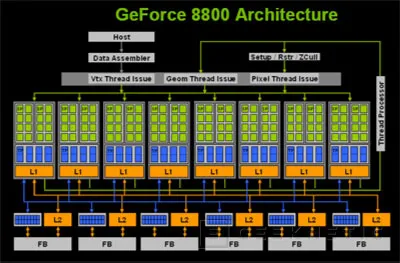

Arquitectura unificada para DirectX 10. Los procesadores gráficos han pasado de ser meros rellenadores de polígonos a disfrutar de una potencia de calculo y una versatibilidad de programación que hacen de ellas procesadores inmensamente complejos y potentes que dejan en ridículo algunas de las capacidades de los procesadores de uso general. El problema es que el desarrollo de meros rellenadores a procesadores programables de un ámbito mas general se ha llevado de una forma equivocada haciendo que se dividieran las funciones de los mismos según la tarea a realizar, o el calculo de funciones avanzadas, o la mera tarea de relleno.

La arquitectura 3D de la 8800GTX

La arquitectura 3D de la 8800GTX. Como siempre nVidia se inventa bonitos nombres para diferenciar los distintos aspectos técnicos de sus chips gráficos. La verdad es que este es la primera gran mejora técnica de nVidia desde los tiempos de la Geforce 4 así que es interesante repasar los cambios y las nuevas técnicas y prestaciones que nos ofrece el G80.

Quantum Effects y especificaciones

Quantum Effects y especificaciones. Otro de los puntos donde nVidia ha querido realizar mas hincapié en cuanto al marketing del nuevo chip es lo que ellos llaman la unidad Quantum Effects y que se supone que se aplica al calculo de física aplicada a los juegos. Lo cierto es que gracias al sistema unificado y programable de su núcleo igual podríamos usar esto para calcular complejas formulas de física aplicada a simulación 3D como a que nos calculase sonido o inteligencia artificial. No es mas que el esfuerzo de nvidia para hacernos ver que lo de Ageia esta controlado y que dentro de poco y gracias a su fuerza en cuanto a adopción por los desarrolladores de juegos, tendrán en el mercado su solución de física gracias al uso de una o mas tarjetas graficas de su marca. Especificaciones y diferencias. De momento encontraremos dos versiones del G80 en las tiendas. Por un lado la GTX, que es la versión más completa del G80, y por otro lado la 8800GTS que no es mas que una versión recortada de la GTX. Las diferencias mas notables son la cantidad de memoria disponible, que pasa de 768MB a 640MB, el bus de datos de la memoria que pasa de 384-Bit a 320-Bit. La otra diferencia fundamental es que el núcleo principal de la GTS la componen 96 "stream processors" frente a los 128 de la GTX lo que las hará diferenciarse bastante sobretodo cuando se empiecen a aplicar de verdad las técnicas ofrecidas por el Shader Model 4 de DirectX 10.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!