Nvidia Geforce GTX 980Ti

por Javier Rodríguez 8Introducción y especificaciones técnicas

Introducción

Casi desde el lanzamiento de la Geforce GTX Titan X sabíamos que Nvidia preparaba una versión “Ti” de su gama alta doméstica. Este nuevo modelos redibuja la gama de Nvidia pero no elimina ningún otro modelo del catálogo. Por los números veremos una mejora notable en las prestaciones de la gama domestica puesto que esta tarjeta supone un salto importante sobre la Geforce GTX 980 que era el modelo anterior como referencia en esta gama.

Nvidia ha ido también ampliando las prestaciones de sus tarjetas Maxwell, preparándose para la incorporación de DirectX 12, también para la revolución de realidad virtual que seguramente llegará en 2016 y ampliando la funcionalidad de su tecnología Gsync haciéndola más versátil.

Especificaciones técnicas

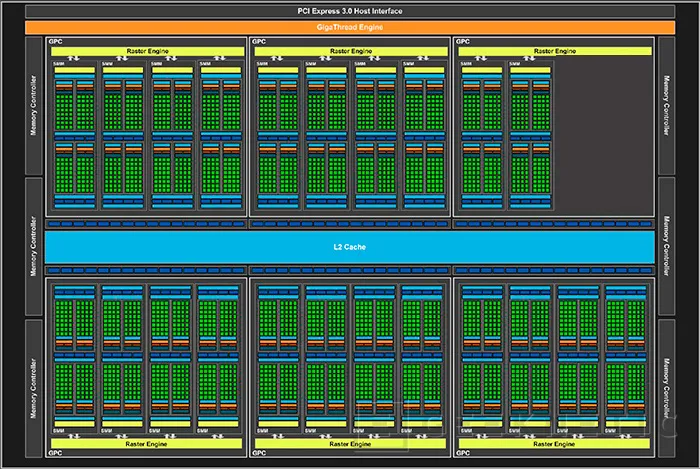

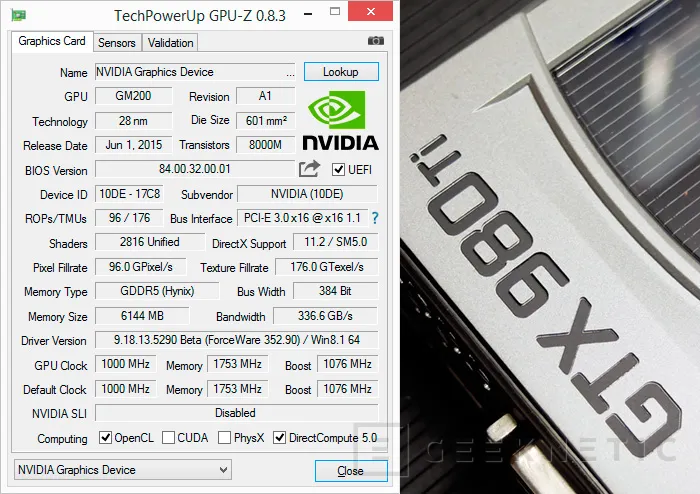

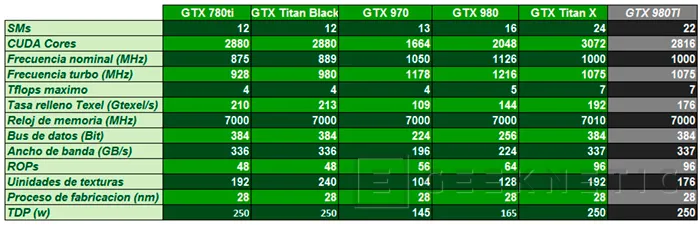

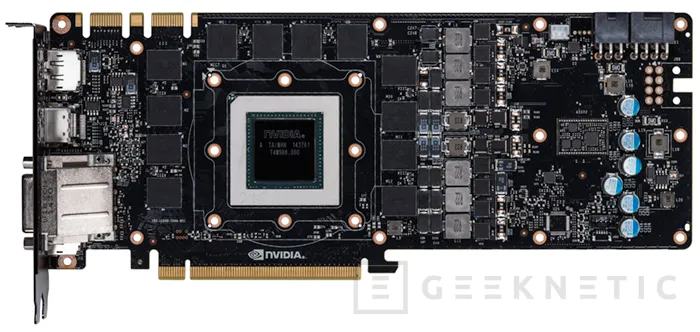

La Geforce GTX 980Ti es una colección de prestaciones entre la Geforce GTX 980 y la Geforce GTX Titan X. Lo bueno es que está más cerca de esta segunda que de la primera pero hay diferencias claras entre unas y otras. Dentro de ella la misma arquitectura Maxwell con la que tanto hemos disfrutado por su magnífico equilibrio entre prestaciones, capacidad de overclocking y consumos controlados. Siempre en un formato bastante compacto y amigable, al menos en las versiones de referencia que son las que nosotros analizamos en cada lanzamiento.

Lo que más destaca en la relación de especificaciones de la nueva GeForce GTX 980Ti es que monta casi un 40% más de motores de shaders que una Geforce GTX 980. Tan solo 256 motores de shaders menos que una Geforce GTX Titan X. Esto se debe a que usa un total de 22 unidades de multiproceso donde también contamos con un total de 176 unidades de texturas y una excelente cifra de 96 unidades ROPs.

Las frecuencias de trabajo de la Geforce GTX 980Ti son las mismas que encontramos en la Geforce GTX Titan X. Son 1000MHz en su frecuencia base y hasta 1075MHz en su frecuencia “Boost”. El framebuffer incorporado es de 6GB de memoria GDDR5 con un bus de datos de 384-Bit que produce casi 337GB/s de ancho de banda, un 50% más que en la Geforce GTX 980. Mismas cifras que la Geforce GTX Titan X salvo que ésta segunda monta 12GB de VRAM.

Llegados a este punto nos podemos dar cuenta de que la Geforce GTX 980Ti es una Geforce GTX Titan X con cuatro recortes, y en las pruebas veremos eso mismo, pero ojo esta tarjeta no costará la mitad ni mucho menos. Los precios establecidos por Nvidia para restructurar la gama coloca en unos 500 Euros a la GeForce GTX 980, 739 Euros para la Geforce GTX 980Ti y 999 Euros para la GeForce GTX Titan X. Son precios elevados, a nadie le gustarán, pero si lo miramos objetivamente esta vez sí se han estructurado debidamente.

Siguiendo el análisis de las especificaciones técnicas podemos añadir que la GeForce GTX 980Ti también será capaz de mover en 4k casi cualquier juego aunque no con la soltura que a todos nos gustaría. Como ya dijimos en el análisis de la Geforce GTX Titan X el que quiera un rendimiento de gran calidad en resoluciones 4k tendrá que montar al menos dos de estas tarjetas en paralelo.

Podemos montar hasta cuatro tarjetas como ésta en el mismo PC. Monta un puente SLI doble, con el que sin duda, los más ansias de los FPS, podrán saciar su hambre en cualquier resolución que le echen. El consumo de 250w no es una cifra a desdeñar pero está dentro de lo razonable para una tarjeta o incluso para alguna más en un PC doméstico. Esta cifra se ha demostrado también más que manejable por el sistema de disipación de referencia de Nvidia.

4K. DSR y MFAA

4K. DSR y MFAA

Una tarjeta con menos ancho de banda de memoria no parece una forma lógica de acercarse a algo que cada día será más común que es disponer de una pantalla con resolución 4k (3840x2160) en casa o en el trabajo. Más aún cuando la reducción es importante y todavía hay una dependencia grande del ancho de banda de memoria para rellenar la pantalla con gráficos.

Menos ancho de banda pero más optimización. Nvidia cree en este camino y la verdad es que con los resultados obtenidos en nuestras pruebas parece que el resultado, sino espectacular, sí que aporta mejoras a pesar de lo que podrían indicar los números en un primer análisis. La optimización fundamental en 4k, a mi parecer, que introduce este nuevo chip lo encontramos en varios elementos que analizaremos en las siguientes páginas.

Básicamente mejores algoritmos tanto en el tratamiento de la calidad de imagen como en la gestión de texturas de grandes dimensiones que permiten no solo un mejor rendimiento en pantallas 4k sino que además invita a que el usuario, en ciertos juegos, aproveche la capacidad de proceso de la tarjeta para renderizar contenido 4k aunque su monitor sea de resolución 1080p.

A esto, que muchos hemos hecho forzando a nuestro sistema a detectar nuestra pantalla como algo que no es, Nvidia le ha puesto nombre DSR. “Dynamic Super Resolution” no es otra cosa que aplicar a nuestra pantalla una imagen renderizada en 4k con un filtro de reducción de pantalla que aumenta la definición y tiene un efecto de antialising 4x o superior con algo menos de afectación al rendimiento. Es como cuando cogemos una fotografía de alta resolución, aplicamos un filtro de reducción de tamaño con enfoque en este caso con un algoritmo gaussiano que mejora la definición de líneas y permite calidad 4k en pantallas de menos definición. Como podéis ver en nuestra captura realmente la imagen generada es a 4k pero nuestro monitor muestra sus 1080 puntos nativos.

Otra de las tecnologías o mejor dicho de los algoritmos introducidos por Nvidia para esta generación de tarjetas (que seguramente también beneficien poco a poco a modelos anteriores a nivel de actualizaciones de drivers) que optimizan el ancho de banda de esta tarjeta aprovechando su potencia de cálculo es el MFAA. El multi-frame sampled Antialiasing es el nuevo algoritmo de Nvidia para corrección de filos en pantalla y afronta este reto desde un punto de vista bastante inteligente.

Lo que hace este sistema es generar dos frames, en vez de “samplear” diferencias entre cuatro puntos circundantes como hace el método tradicional, con un filtro aplicado que se traduce en una calidad similar al MSAA 4x (el que aplica DirectX) con la afectación de rendimiento que encontraríamos en un sistema MSAA 2x con algo más de carga de proceso en el algoritmo de cálculo que hace de filtro para igualar niveles de calidad y reducción de filos entre texturas de polígonos. En definitiva otro método para que esa reducción de ancho de banda no se traduzca en una pérdida de rendimiento en técnicas tan apreciadas para mejorar la calidad de imagen de los juegos como es el antialiasing.

Compresión de memoria y DX12

Compresión de memoria y DX12

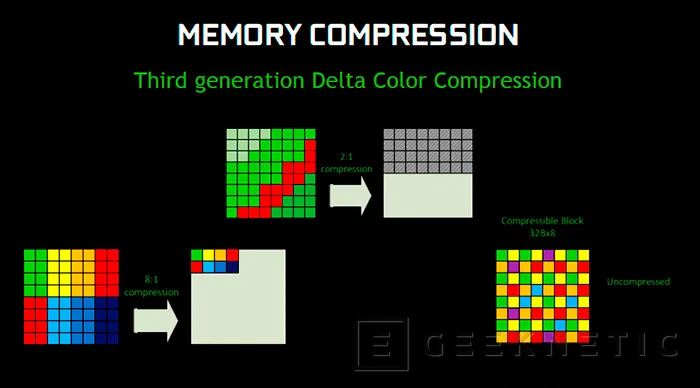

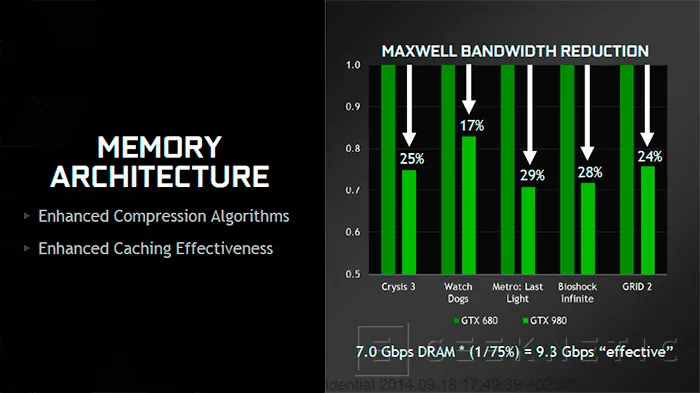

Otros de los puntos donde parece que Nvidia ha mejorado de forma notable la eficiencia en la gestión del ancho de banda de la memoria integrada es en la compresión de texturas en su paso por el bus de datos. Su tecnología “Delta Color Compression” ya va por la tercera generación y se compone de dos elementos: algoritmos mejorados de compresión de color y por otro lado una mejora de la efectividad de la cache aplicada a estos procesos. Esto en buena parte se logra con el aumento a 2MB de cache en la GPU, el cuádruple que la generación anterior.

Con esto, Nvidia afirma que sus requerimientos de ancho de banda en diversos títulos de uso intensivo de memoria, como puede ser “Metro: Last Light” o “GTA V”, mejoran en torno al 25% la efectividad del ancho de banda real de la tarjeta. Según Nvidia, la Geforce GTX 980Ti, con su bus de datos de 7gbps, en realidad logra un bus efectivo de 9,3Gbps que se traduce en mas de 400GB/s de ancho de banda teórico. Sea como fuere esto y otras mejoras, como el MFAA parecen lograr el objetivo de no echar de menos el 30% de reducción de ancho de banda entre el GK110 Kepler (Geforce GTX 780) y el GM200-310 que da vida a esta tarjeta.

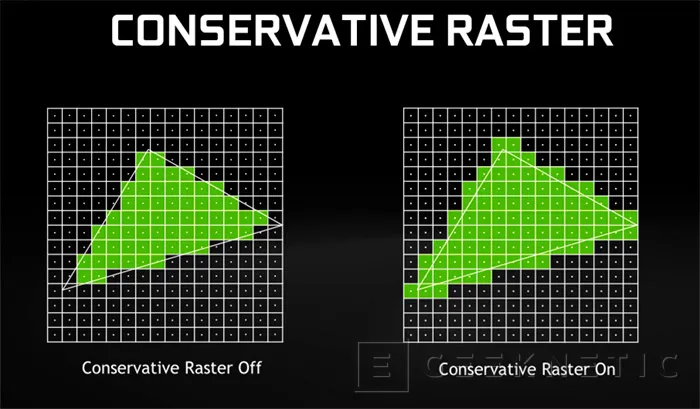

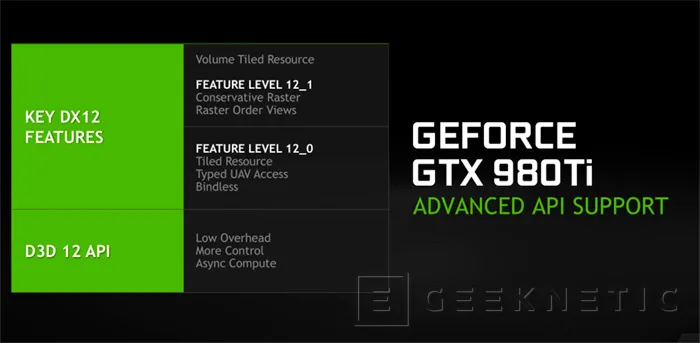

Nvidia ya ha dado más detalles del soporte que tendrán sus nuevas GPU con la llegada de DirectX 12. Windows 10 está a la vuelta de la esquina y los primeros juegos con esta API no tardarán mucho más en llegar. Las gráficas de Nvidia parece que tendrán un soporte bastante completo del nuevo API que incluye algunas de las prestaciones muy interesantes como la reducción de la necesidad de la CPU para el cálculo poligonal, la computación asíncrona, rasterización conservativa, etc.

Prestaciones de una API de bajo nivel que permitirá, por fin, más independencia de la tarjeta gráfica sobre la CPU del ordenador y que nos permitirá optimizar mejor la composición de nuestro ordenador logrando mejores resultados según nuestras necesidades. Se añaden técnicas gráficas también como “Shadow raytracing” que permite sombreados hiperrealistas combinando la “rasterización conservativa” con la definición de la sombra por trazado de rayos.

Se espera incluso que estos modelos sean compatibles, al menos en parte, con DirectX 12.1 que ya está en su fase de definición. Con esta nueva API algunas gráficas recibirán un impulso de rendimiento adicional aunque esto se verá más traducido en juegos más capaces y en una realidad virtual más avanzada.

GameWorks VR y GSync

GameWorks VR y GSync

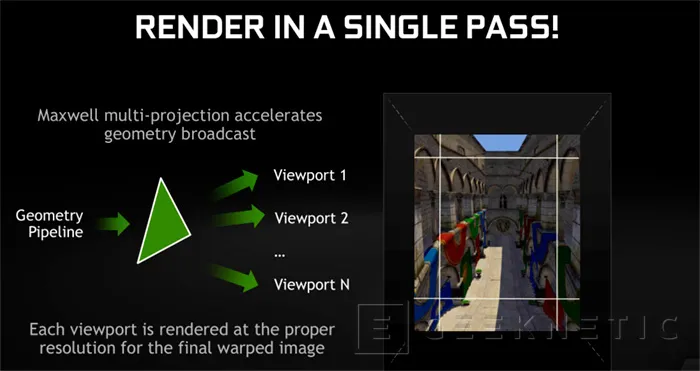

Nvidia parece estar trabajando duro para adaptar sus productos y tecnologías a la revolución de la realidad virtual que parece que acontecerá con más claridad el año que viene. Por fin se esperan productos comerciales para esas fechas y los fabricantes de chips gráficos, desarrolladores y APIs tienen que jugar un papel muy importante para que la realidad virtual se convierta en una “realidad”.

Uno de los problemas más importantes a los que se enfrenta la eficiencia gráfica a la hora de generar imágenes para un sistema de realidad virtual es que tiene que generar dos imágenes, una para cada ojo, y éstas además tienen que ser adaptadas a la óptica de un campo visual ancho para cada ojo. Una GPU no puede generar estas imágenes por sí sola y siempre hay trabajo de más que no se aprovecha.

La solución de Nvidia es dividir la imagen en “puntos de vista”, escalar los filos de cada punto de vista, todo en el mismo paso de renderizado. De este modo pretenden lograr una mejora de rendimiento entre 1.3 y 2 veces sobre los métodos tradicionales. Esto estará presente en la API Gamerworks VR de Nvidia.

A esto se añade ya otras tecnologías incorporadas como el VR SLI (usar dos o más gráficas para sistemas de realidad virtual), priorización de contexto, Direct Mode (que predice los movimientos del usuario y para reducir latencias), etc. Todo para algo que aún esta por convencer al mercado y a los jugadores.

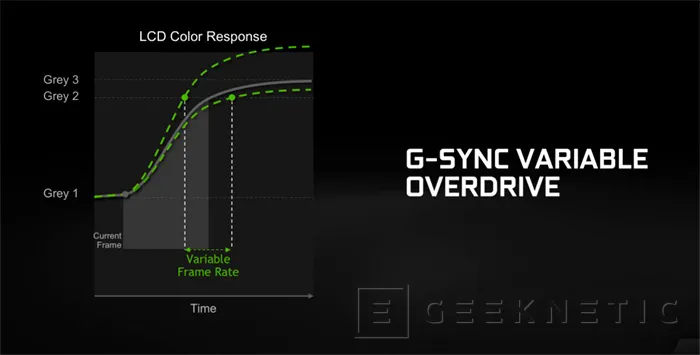

El Gsync también recibe mejoras interesantes, aparte de su incorporación en portátiles. Como sabéis el sistema Gsync utiliza electrónica propietaria de Nvidia para igualar la frecuencia vertical del monitor compatible con los FPS reales que ofrece la tarjeta gráfica. Es la gráfica la que toma el control del monitor para reducir defectos de imagen, latencias en introducción de comandos, etc.

En el Gsync se están haciendo mejoras interesantes como la incorporación del “Gsync Variable OverDrive” que permite controlar a la gráfica los cambios de pixel para reducir el impacto en la calidad del color. Como todos sabéis los monitores tienen una velocidad de respuesta de pixel que es más grande en paneles de calidad (aunque está cambiando) como el IPS. El Gsync podrá controlar y aumentar la velocidad de actualización, mediante sobre alimentación, para reducir el impacto en la profundidad de color en imágenes de rápido cambio como son los juegos.

Gsync también introduce algunos otros “trucos” interesantes. Ya conocíamos el soporte de Gsync en sistemas SLI pero ahora se añade el soporte en ventana. Es decir, ya no tendremos que correr nuestros juegos en “pantalla completa” para aprovechar las prestaciones y la calidad que nos ofrecen los sistemas de sincronización vertical delegada en la GPU. Para mí, que juego mucho a Diablo 3 en ventana, es una gran noticia y seguro que para miles de jugadores de juegos tipo MOBA, también.

El modelo de referencia. Consumo y ruido

El modelo de referencia. Consumo y ruido

Hay gente que prefiere modelos personalizados, con complejos sistemas de ventilación y docenas de heatpipes recorriendo la tarjeta, pero yo prefiero los modelos de referencia en las gráficas de Nvidia. Un montaje sencillo y eficiente con unos acabados de calidad y un tamaño que nos permite montarlas en casi cualquier ordenador.

El modelo de referencia no ha cambiado nada, podéis verlo en nuestra foto de familia con la Geforce GTX 980, Geforce GTX 980Ti y la Geforce GTX Titan X. Lo único que cambia es el color de la última. Los modelos de referencia de Nvidia están pensados para ofrecer un desempeño de calidad para los consumos habituales de estas tarjetas. Cuenta con una turbina posterior que ventila un bloque de disipación con cámara de vapor y se expulsa el aire por el frente de la tarjeta hacia el exterior de la caja del ordenador.

Las tres últimas gráficas de Nvidia: Geforce GTX 980, Geforce GTX Titan X y Geforce GTX 980Ti.

Los modelos más nuevos, de referencia, no mantienen el diseño de backplate de la Geforce GTX 980.

Es para mí un sistema que no solo piensa en la gráfica sino en el desempeño térmico de todo el sistema. Compacto y diseñado para sistemas SLI donde todas las tarjetas tengan un comportamiento adecuado.

Sí es verdad que Nvidia ha resuelto que sus tarjetas de esta gama están mejor sin backplate y, aunque este modelo estéticamente se parece más a la Geforce GTX 980, la Geforce GTX 980Ti tampoco cuenta con el backplate que ya se eliminó en el diseño de la Geforce GTX Titan X. El ruido para mí no es un problema en esta gráfica, solo nos hará sufrir algo más cuando tenemos niveles de overclocking elevado y siempre y cuando estemos usando la gráfica al 100% de su potencial.

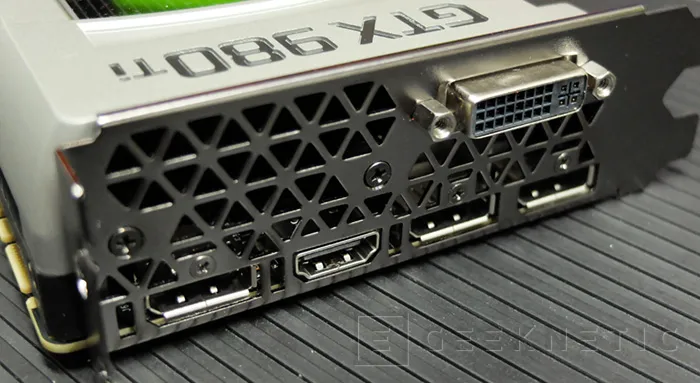

El modelo de referencia nos facilita tres conexiones Displayport 1.2, con capacidad 4k@60hz, un puerto HDMI 2.0 también con soporte 4k@60Hz y una conexión DVI de doble enlace con compatibilidad para resoluciones 2k. Podemos usar hasta cuatro monitores simultáneamente o monitores en cadena gracias a la tecnología Displayport.

Los consumos de 250w también hay que tomarlos con algo más indicativo de uso medio que un máximo de consumo real. Lo cierto es que en nuestras pruebas, de uso común como el que haría cualquiera en su casa jugando a un juego exigente, nos indican un consumo más cercano a los 275w que a los 250w y sin overclocking.

El modelo de referencia monta un conector PEG de 8 contactos y otro PEG de seis contactos. Eso son 150+80w de potencia externa que se suman a los 80 vatios del slot PCI Express. Tendremos, por tanto, un potencial máximo de energía hacia la tarjeta de 310w. Eso limita el overclocking accesible en los modelos de referencia.

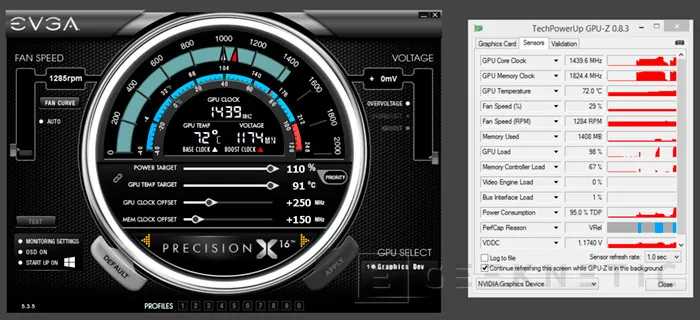

Overclocking y rendimiento. I

Overclocking y rendimiento. I

El overclocking que hemos obtenido de la Geforce GTX 980Ti es más o menos el que podemos obtener de una Geforce GTX Titan X. Tienen el mismo sistema de disipación, el mismo sistema de alimentación y prácticamente el mismo chip gráfico. Es decir, un resultado espectacular. Esta gráfica puede, con facilidad, superar los 1400MHz de frecuencia sin tener que subir voltajes. Un resultado espectacular pero digno de su arquitectura puesto que todas las Maxwell son grandes chips para overclocking.

Estos niveles de overclocking se traducen también en algo más de ruido cuando la tarjeta está en carga y también en más consumo ya que fácilmente, sin tocar voltaje siquiera, alcanzaremos los 300w de consumo.

Mesa de pruebas:

Procesador: Intel Core i7-5960X

Placa Base: ASUS Rampage V Extreme

Memorias: Gskill DDR4 F43000C15 4x4 Quad Channel

Fuente de alimentación: Seasonic Platinum Series 1200w

Driver: 350.92

Rendimiento 1080p:

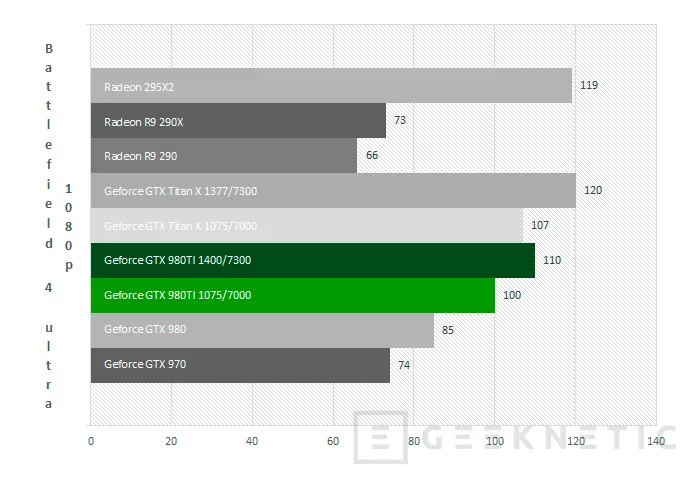

Battlefield 4. 1920x1080. Calidad Ultra

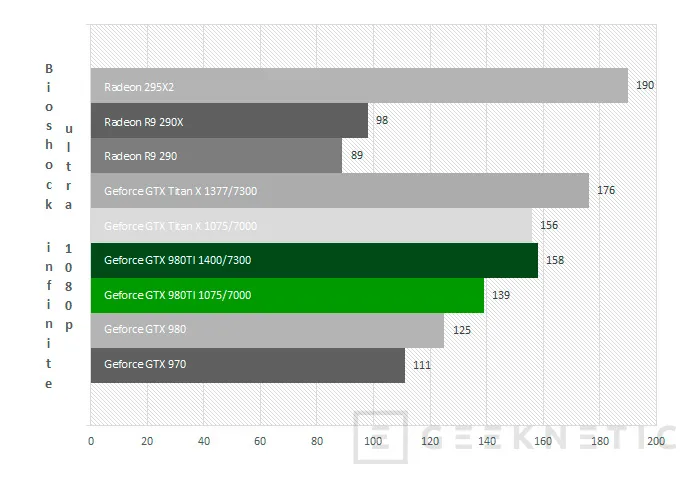

Bioshock Infinite. 1920x1080. Calidad Ultra

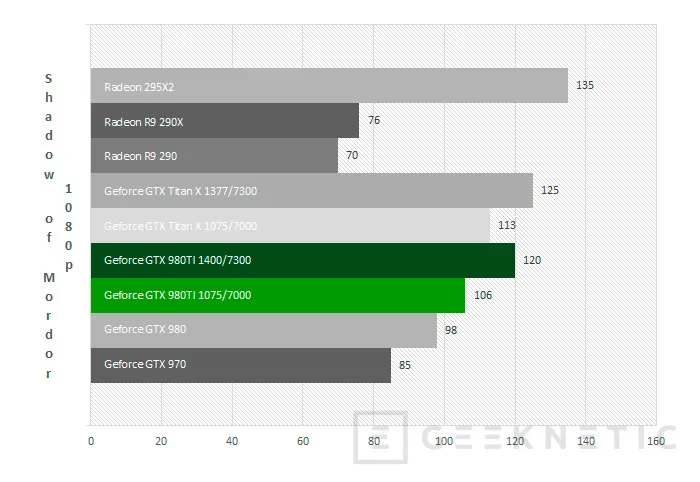

Shadow of Mordor. 1920x1080. Calidad ultra. Benchmark.

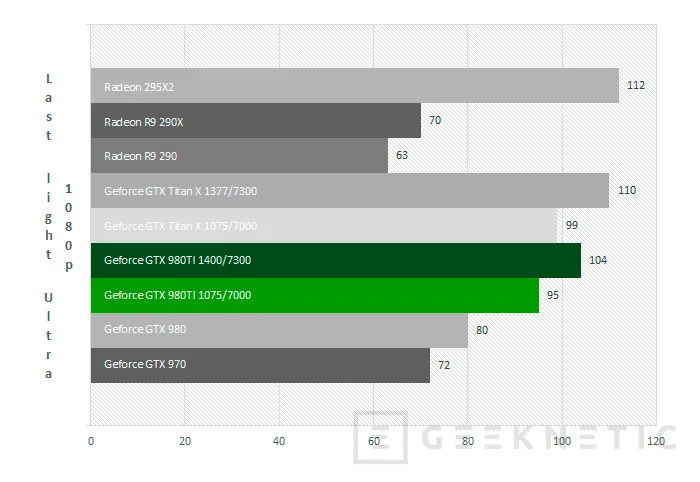

Last Light. 1920x1080. Calidad Muy Alta.

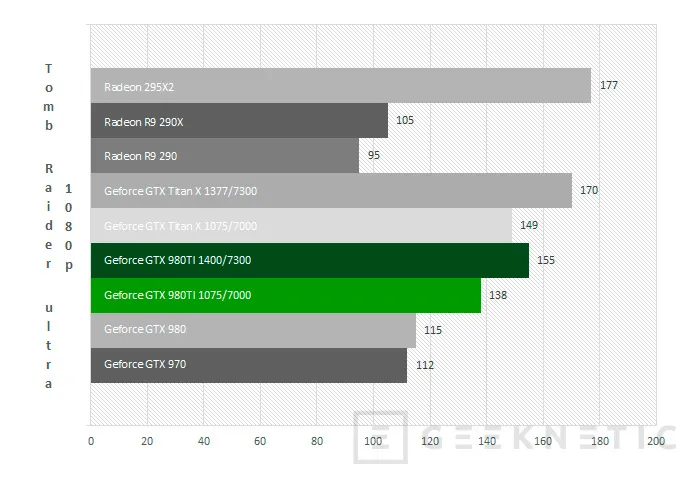

Tomb Raider. 1920x1080. Calidad Ultra

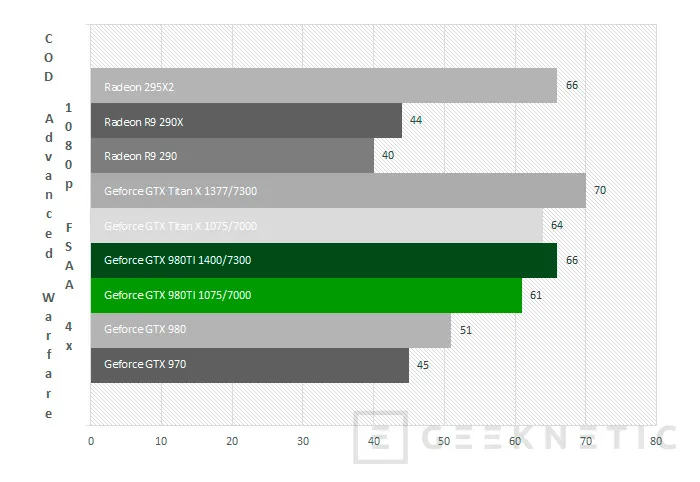

COD Advanced Warfare. 1920x1080 FSAA 4x

Rendimiento 4k, 3DMark y Valley benchmark

Rendimiento 4k, 3DMark y Valley benchmark

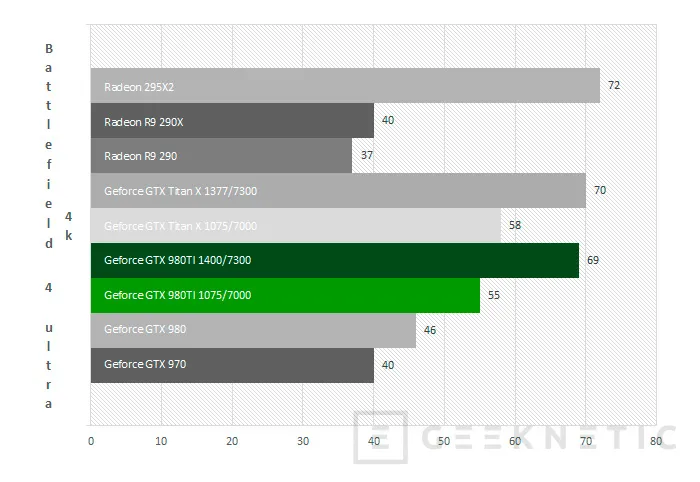

Battlefield 4. 3840x2160. Calidad Ultra

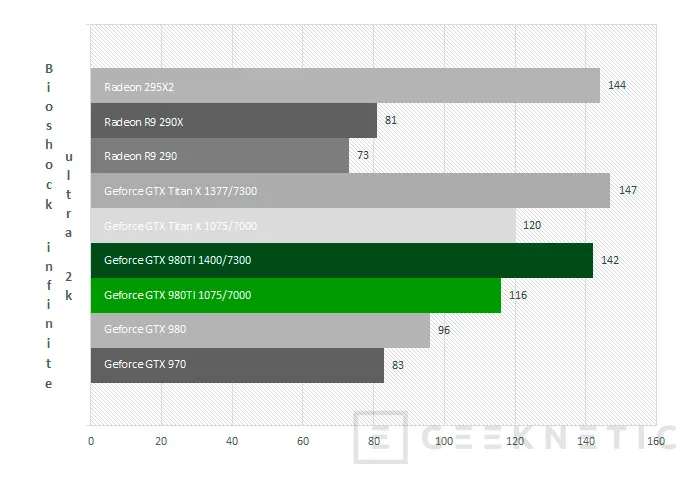

Bioshock Infinite. 2560x1440. Calidad Ultra

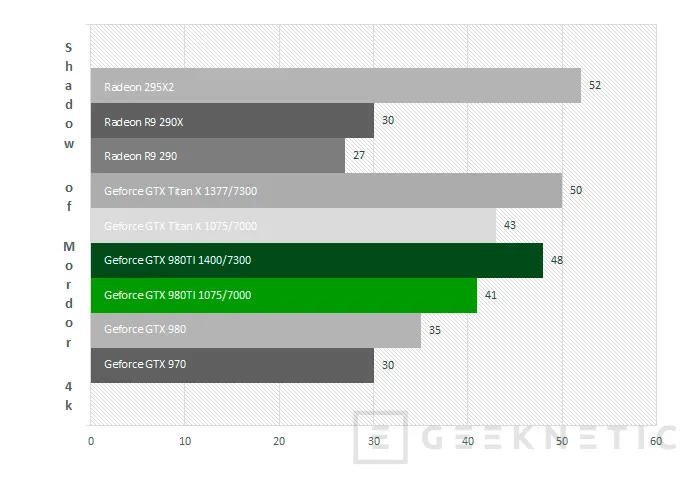

Shadow of Mordor. 3840x2160. Calidad ultra. Benchmark

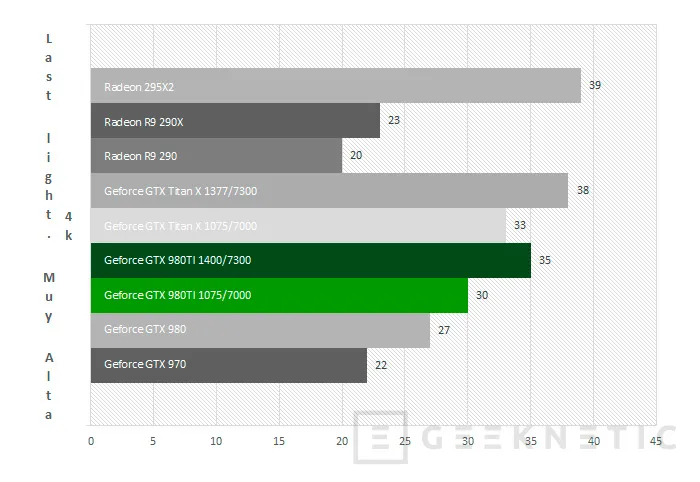

Last Light. 3840x2160. Calidad Muy Alta

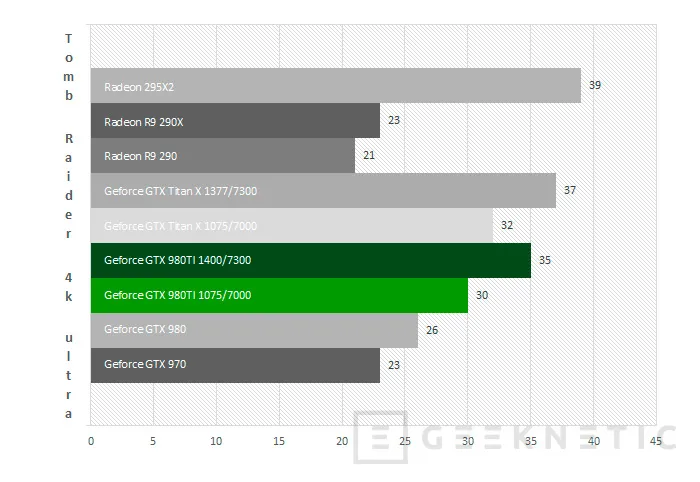

Tomb Raider. 3840x2160. Calidad Ultra

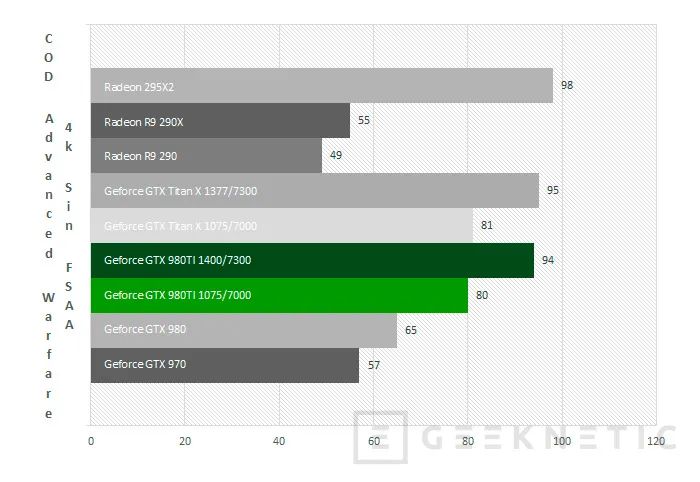

COD Advanced Warfare. 3840x2160 sin FSAA

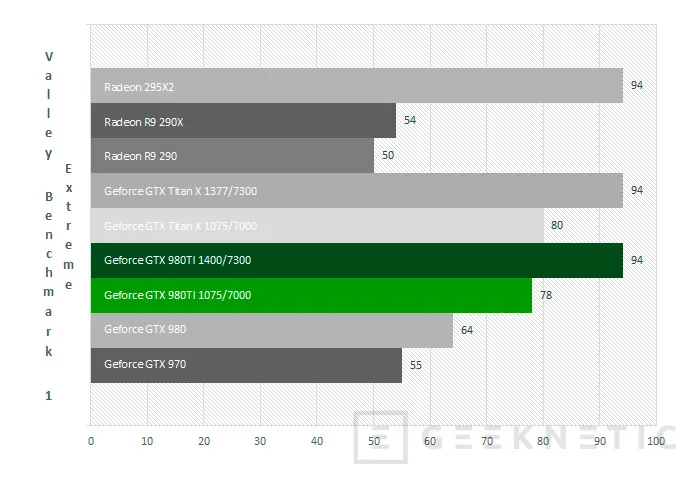

Valley Benchmark 1.0

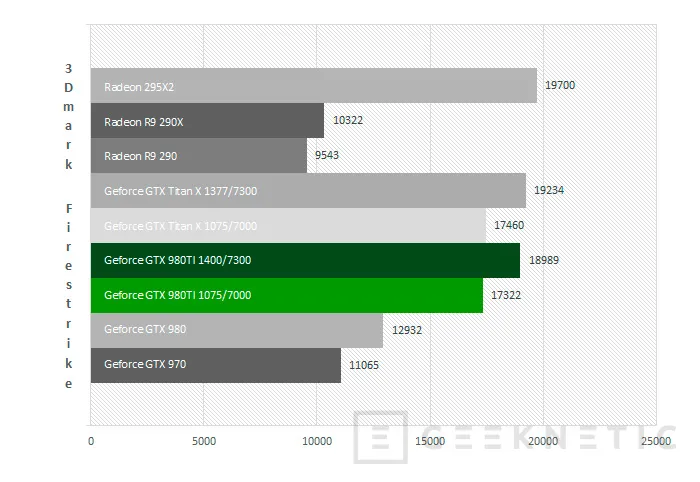

3DMark Firestrike

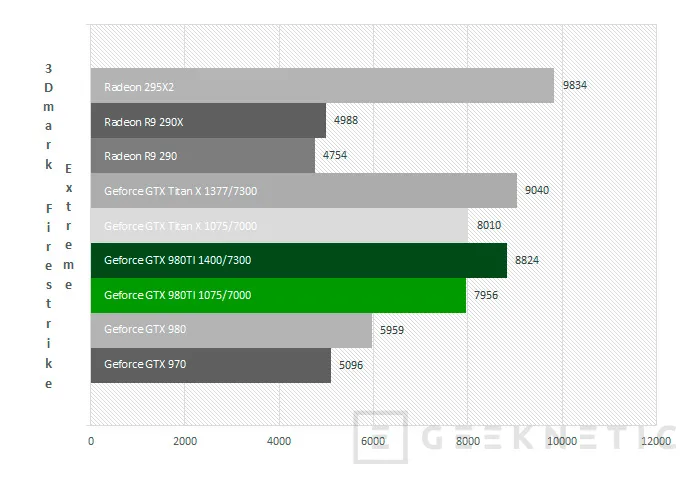

3DMark Firestrike Extreme

Análisis de resultados y Gameplay

Análisis de resultados y Gameplay

Estaba claro que con la misma arquitectura, la Geforce GTX 980Ti iba a igualar mucho su rendimiento a la Geforce GTX Titan X. Son tarjeta gráficas muy parecidas y esto se traduce en un rendimiento algo inferior pero muy similares, menos de un 5% en algunas pruebas. Esto significa varias cosas. Primero que la Geforce GTX Titan X deja de tener tanto sentido y segundo que esta generación sigue estando algo limitada para ser usada en pantallas 4k. A resoluciones inferiores los resultados son espectaculares pero a 4k una de estas gráficas sigue quedándose un pelín corta sobre todo para los que gustan de tener siempre los juegos a sus máximos en calidad gráfica.

Por otro lado es una gráfica con un gran potencial de overclocking y con un consumo bastante controlado y logra muy alto rendimiento en resoluciones 1080p y sería perfectamente adecuada para mover monitores de alta frecuencia de muestreo vertical con o sin Gsync. Para los que estén todavía, inteligentemente, anclados en las 2k una sola de estas tarjetas es su solución definitiva para mover los mejores juegos a calidades muy altas.

Diablo 3 Gameplay 4k:

The Witcher 3 Gameplay:

GTA V Gameplay:

Battlefield Hardline:

BattleField IV. 1080p. Ultra:

BattleField IV. 4k. Ultra y high:

Conclusión

Conclusión

Sin grandes novedades pero sin parar, Nvidia ha inundado el mercado con sus gráficas de arquitecturas Maxwell. Una arquitectura que a mí me recuerda mucho a la incorporación de la arquitectura Core de Intel por su rendimiento, capacidad de overclocking y eficiencia. Quizás no han dado con la tecla para ofrecer una solución definitiva para mover las 4k con soltura en PC, pero es un buen punto de partida que culminará en próximas generaciones. De momento los procesos de 28nm han dado más de lo que cabía esperar de ellos y eso sin duda es gracias a un buen trabajo a nivel de diseño.

La competencia de Nvidia debería responder este mes que entra pero aún no tenemos claro cuál será su potencial y qué pondrán en el mercado para competir con una gama que a día de hoy muestra una solidez y una madurez muy lograda y por tanto con una buena capacidad de defensa. Los precios siguen altos para mi gusto pero al menos Nvidia en esta ocasión ha ajustado precios en toda la gama para recolocarla adecuadamente. La Geforce GTX 960 sobre los 200 Euros, Geforce GTX 970 sobre los 350 Euros, Geforce GTX 980 algo más de 500 Euros, Geforce GTX 980Ti por algo más de 730 Euros y finalmente, la Geforce GTX Titan X que baja de los 1249 Euros a los 999 Euros.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!

- Producto: Nvidia Geforce GTX 980TI

- Fecha: 31/05/2015 22:25:43